长文本时代已来:DeepSeek-V4点燃AI存储新机遇

大模型领域的范式转移,往往由一个关键参数的质变引发。“如果说大模型参数决定了AI的‘智商’,那么上下文窗口则决定了它的‘记忆力’与‘处理负责任务的上限’。随着DeepSeek-V4的登场,行业视野正从单纯的算力堆砌,转向长序列数据吞吐与存储效率的深度博弈。

DeepSeek-V4最引人瞩目的突破,莫过于其上下文窗口(Context Window)实现了8倍的跨越式增长——从128K陡增至1M。不仅如此,研发路线图明确指向了2M、10M乃至无限长的上下文愿景。这一进化,不仅是算法的胜利,更向背后的存储产业投下了一颗深水炸弹。

长文本驱动应用爆发,万亿级存储新机遇加速形成

当上下文窗口迈入1M乃至更高,大模型正从“短对话处理”走向“复杂任务处理”,应用边界将会被全面打开。

模型可以一次性解析数千张医疗影像或在数千页文档中完成深度关联分析。与此同时,AI正从单轮问答升级为多轮推理的智能体(Agent),OpenClaw、Hermes等智能体框架层出不穷,驱动企业级应用并发需求呈指数级增长。

但长上下文能力的背后,是KV Cache(键值缓存)规模的快速膨胀。在推理过程中,每增加一个Token都会带来缓存数据的持续增长,当上下文迈向百万甚至千万级时,显存已无法独立承载,KV Cache缓存已成为AI系统性能的核心挑战,如何存储与调度海量的KV Cache数据成为亟待解决的问题。

在典型企业场景中,单日百万级推理请求已成为常态,对应KV Cache存储需求迈向PB级,在运营商与云厂商等场景中整体规模更将进一步演进至EB级。叠加Agent记忆与行业知识库等新型数据形态,一个面向AI的万亿级存储新机遇,正在加速形成。

存算分离:打破显存孤岛,实现“KV Cache 池化”

传统的推理架构高度依赖显存(HBM),但显存昂贵且容量有限。在超长上下文场景下,KV Cache的容量需求呈线性甚至几何级数增长。一旦显存溢出,推理任务就会中断或性能崩塌。

我们需要一种能缓解缓存压力甚至替代显存、承载海量缓存、且具备极高响应速度的“第二算力底座”。 这为存储产业带来了前所未有的机会。

值得关注的是,DeepSeek与华为早已洞察这一趋势,双方在技术理念上高度同频,均以存算协同为核心,致力于打造高效、可扩展的KV Cache管理体系。

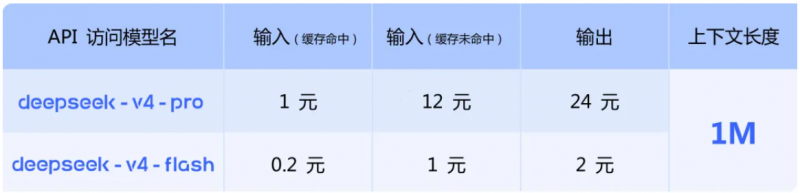

DeepSeek-V4之所以能处理海量上下文,核心精髓在于其存算分离的架构——通过3FS存储系统实现了千PB级的KV Cache池化,彻底打破了单机显存的物理限制,DeepSeek会将这些海量的KV Cache价值数据保存超过1天时间,用于避免重复计算,对外提供缓存命中的计费方案能力,这也是DeepSeek降低单位token成本的主要方式之一。

这一思路也与华为UCM(推理记忆数据管理)的技术路径高度一致。UCM是华为AI数据平台中的核心组件,其架构设计并不将KV Cache仅仅视为显存中的临时碎片,而是将其作为可池化、可共享的存储资产。这种对存算分离架构的极致优化,使得UCM可以在推理过程中动态调用大规模存储池,将“有限的显存”化为“近乎无限的缓存空间”。

从缓存到记忆:构建Agent的“数字大脑”

随着DeepSeek持续演进EnGram等外挂记忆结构,大模型正在从“瞬时反应”向“长期记忆”跨越。华为AI数据平台也紧随这一趋势,完成了从单纯的KV Cache 加速框架向“KV Cache与Agent记忆合一”的融合框架的转型。

华为UCM即将推出全新的Agent记忆特性。这套体系涵盖了从记忆抽取、管理、沉淀到加速的全生命周期能力。特别是在ToB领域,华为正通过“经验记忆”与“工作记忆”的结合,分享提升Agent作业质量的最佳实践。这意味着,未来的Agent不仅能“读万卷书”,更能通过UCM 实现知识的沉淀与复用,实现知识KV Cache记忆的统一调度,真正具备解决复杂行业问题的能力。

存储,大模型下半场的胜负手

DeepSeek-V4的发布,标志着大模型竞争进入了“长序列、多模态、深场景”的下半场。在这个阶段,单纯堆砌算力已不足以解决问题,如何管理、调度和持久化庞大的KV Cache,将成为提升AI应用并发能力与体验的关键。而“AI算法+存储”的深度协同,将成为企业构建核心竞争力的核心抓手。

随着存储产业与AI算法的深度融合,一个以数据与记忆为中心的新型基础设施体系正在形成,我们正在见证一个新时代的到来:存储不再仅仅是数据的容器,而将成为驱动AI进化的重要引擎。而华为AI数据平台与DeepSeek的同频共振,将持续推动这一变革,引领行业走出KV Cache困局,解锁“长文本+多模态+Agent”的全新应用场景,为AI产业的规模化落地注入源源不断的动力。

(来源:科技信息网)